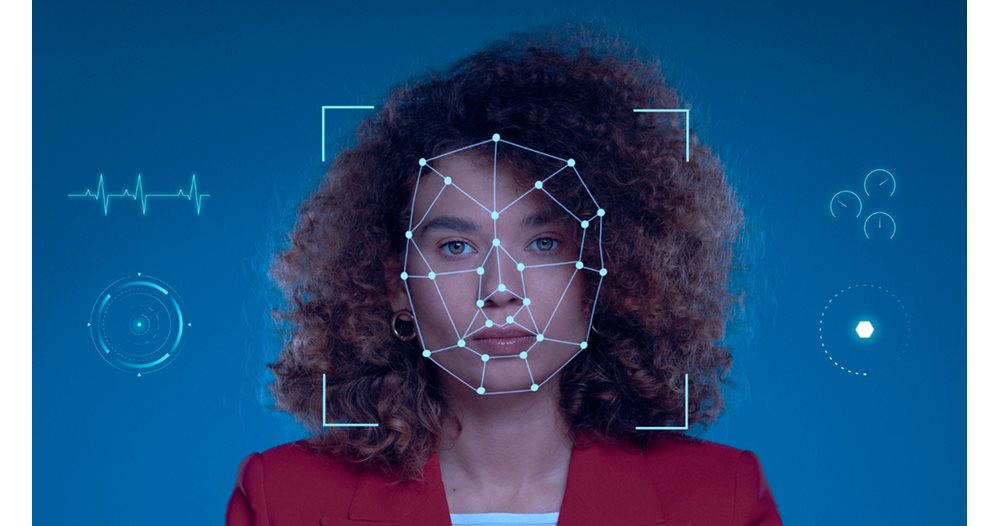

La forme du visage et des oreilles est visible lors de la création d'une vidéo utilisant l'intelligence artificielle

Experts avertissement Non seulement que enfants, Et les adultes aussi Ils peuvent être M'a menti Des faux Épingles

Depuis qu’Internet est arrivé dans nos foyers, les parents disent souvent à leurs enfants de ne pas croire tout ce qu’ils voient en ligne. Mais avec l’avènement de l’intelligence artificielle (IA), il est désormais nécessaire que les adultes apprennent à distinguer le réel de l’irréel sur Internet.

Ceci est important car nous sommes à l’aube du contenu deepfake – un type d’informations créées ou manipulées pour ressembler étroitement aux images et aux voix de personnes réelles.

L’organisation britannique indépendante de vérification des faits Full Fact définit les deepfakes comme « des clips vidéo ou audio créés à l’aide d’outils d’intelligence artificielle pour imiter au moins partiellement avec succès le visage ou la voix d’une personnalité publique ».

D'une vidéo hyperréaliste de l'actrice Margot Robbie passant la serpillière à un enregistrement inquiétant de Vladimir Poutine, le monde a vu quelques fausses vidéos inquiétantes ces dernières années.

Mais comment savoir si les choses ne sont pas telles qu’elles semblent être dans ces clips ? Les professionnels révèlent les six principaux signes qui nous indiquent que le contenu n'est pas réel. Ils insistent sur le fait qu’une attention particulière doit être portée aux oreilles.

Chris Morris, PDG de Full Fact, a déclaré : « À mesure que la technologie progresse, il ne fait aucun doute que les faux produits générés par l'intelligence artificielle deviennent de plus en plus courants sur les réseaux sociaux et ailleurs en ligne, brouillant la frontière entre fiction et réalité. » Il ajoute que même en l'absence de preuve de l'authenticité des passages

C'est difficile d'en être sûr Qu'il soit créé par Amnesty International,

Modifié de toute autre manière ou créé par un imitateur.

Voici quelques conseils complets pour vous protéger contre les arnaques en ligne :

1. Vérifiez la forme du visage et des oreilles.

L’un des moyens les plus simples de savoir si une vidéo est un deepfake est de vérifier la forme du visage. Dans une interview avec la chaîne YouTube Corridor Crew, le concepteur d'IA Chris Umme explique pourquoi la forme du visage est toujours un indicateur que quelque chose ne va pas.

« Dans de nombreux cas, leurs mensurations sont disproportionnées. La meilleure chose que nous puissions faire si nous doutons de l'authenticité d'une vidéo est de trouver une photo de la personne en question et de la placer à côté de la photo de l'enregistrement. Si nous remarquons des différences, la vidéo que nous regardons est très probablement un deepfake.” », explique le spécialiste.

Chris Omi conseille également d'accorder une attention particulière à la forme des oreilles, car elles sont difficiles à simuler.

2. Pouvez-vous retrouver les images originales ?

Si nous ne détectons aucun problème avec la forme du visage, les experts recommandent de vérifier si nous pouvons retrouver les images originales. Cela se fait en recherchant des mots-clés sur des plateformes telles que Google, YouTube et TikTok.

Cependant, si la vidéo ne présente pas de caractéristiques distinctes à rechercher, les experts recommandent d'effectuer une recherche d'image inversée à l'aide de captures d'écran des parties clés de la vidéo.

3. Examinez les expressions et les comportements.

S'il y a une célébrité ou une personnalité publique impliquée dans la vidéo et que nous soupçonnons que nous avons été victime d'une arnaque, il est important de rechercher des comportements ou des moyens d'expression spécifiques. Le professeur Hani Farid, expert en criminalistique de l'image à l'Université de Californie à Berkeley, appelle ces fonctionnalités « biométrie douce ».

Dans une vidéo postée sur YouTube, il donne un exemple

Levant la tête et Léger froncement de sourcils

L'ancien président américain Barack Obama lorsqu'il dit « Bonjour à tous » dans ses discours hebdomadaires.

4. Les yeux sont-ils parallèles ?

Avec les deepfakes, il y a souvent des problèmes d’alignement des yeux, souligne Chris Omi. « Ce n'est que dans des cadres fixes que nous pouvons détecter ces écarts », ajoute-t-il.

Pour vérifier l’alignement des yeux, nous devons mettre la vidéo en pause plusieurs fois et vérifier s’ils regardent dans la même direction.

5. Recherchez les lacunes visuelles

Les experts de Full Fact estiment que les fausses vidéos peuvent sembler convaincantes lorsqu'une personne fait face à la caméra, mais que la technologie peut mal tourner lorsqu'elle est de côté. « Vous pourrez peut-être détecter de telles erreurs si vous ralentissez les pneus », disent les experts.

Cela facilitera l’identification des points où la technologie ne parvient pas à faire correspondre parfaitement le visage généré par l’IA avec la partie réelle de la vidéo.

6. L'audio est-il correctement synchronisé avec la vidéo ?

Enfin, les experts recommandent une analyse phonologique – les mouvements généraux de la bouche lors de l'émission de différents sons de lettres.

« Après avoir examiné certains des deepfakes les plus réussis, nous avons émis l'hypothèse que parfois le mouvement des lèvres dans les images générées n'est pas tout à fait correct », explique le professeur Freed.

Si nous ralentissons un clip, nous pouvons remarquer que les lèvres ne se plient pas correctement pour correspondre au son qu'elles émettent. Le mouvement de la bouche ne correspond pas au son. Par conséquent, nous pouvons conclure que nous avons rencontré un faux.

:quality(70)/cloudfront-eu-central-1.images.arcpublishing.com/thenational/DGHHUSLKXNDH5FBBBWAK3NZXSY.jpg)